Nvidia ha ufficializzato la sua nuova architettura GPU Blackwell con un aumento delle prestazioni fino a 5 volte rispetto a Hopper H100.

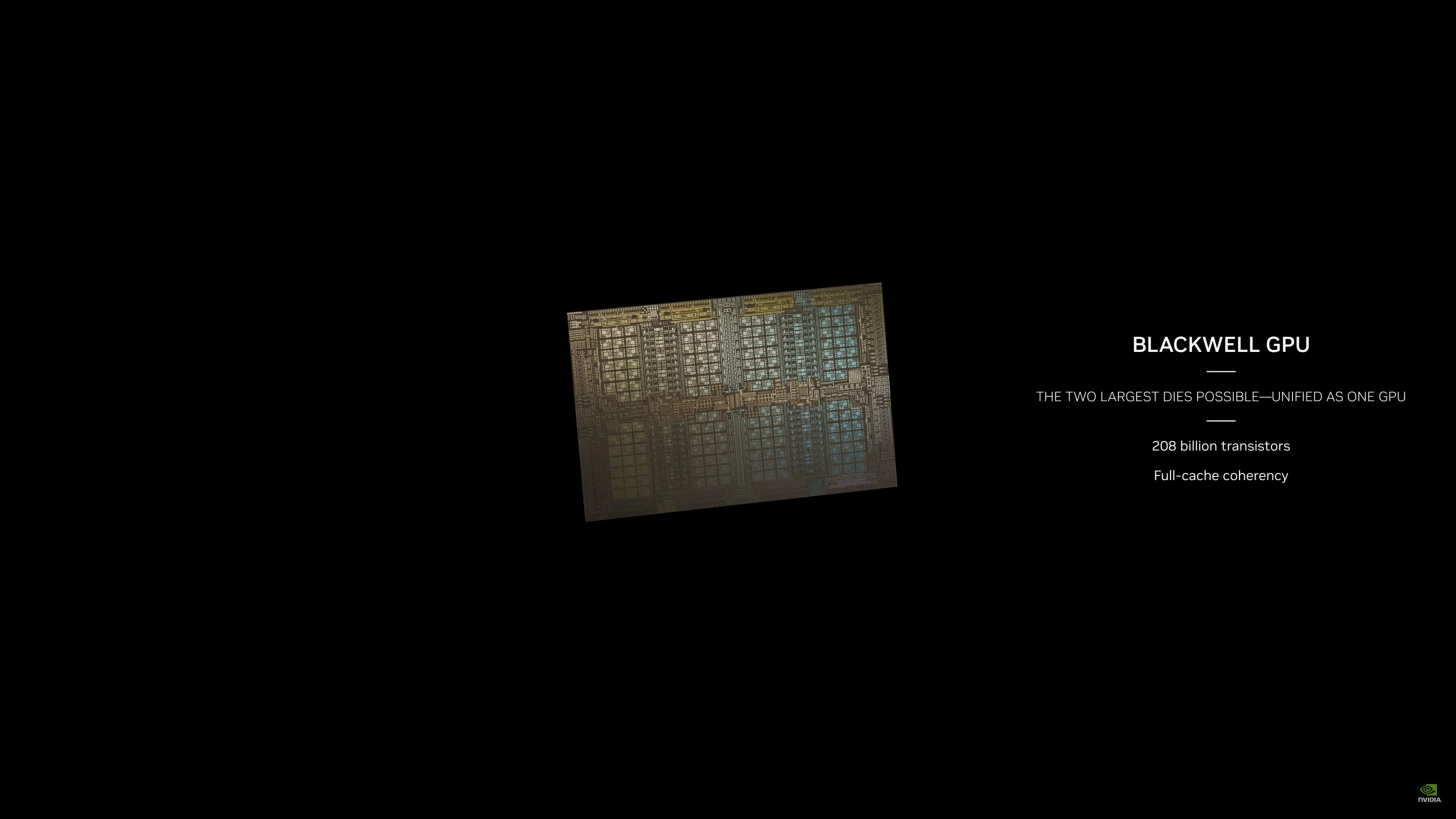

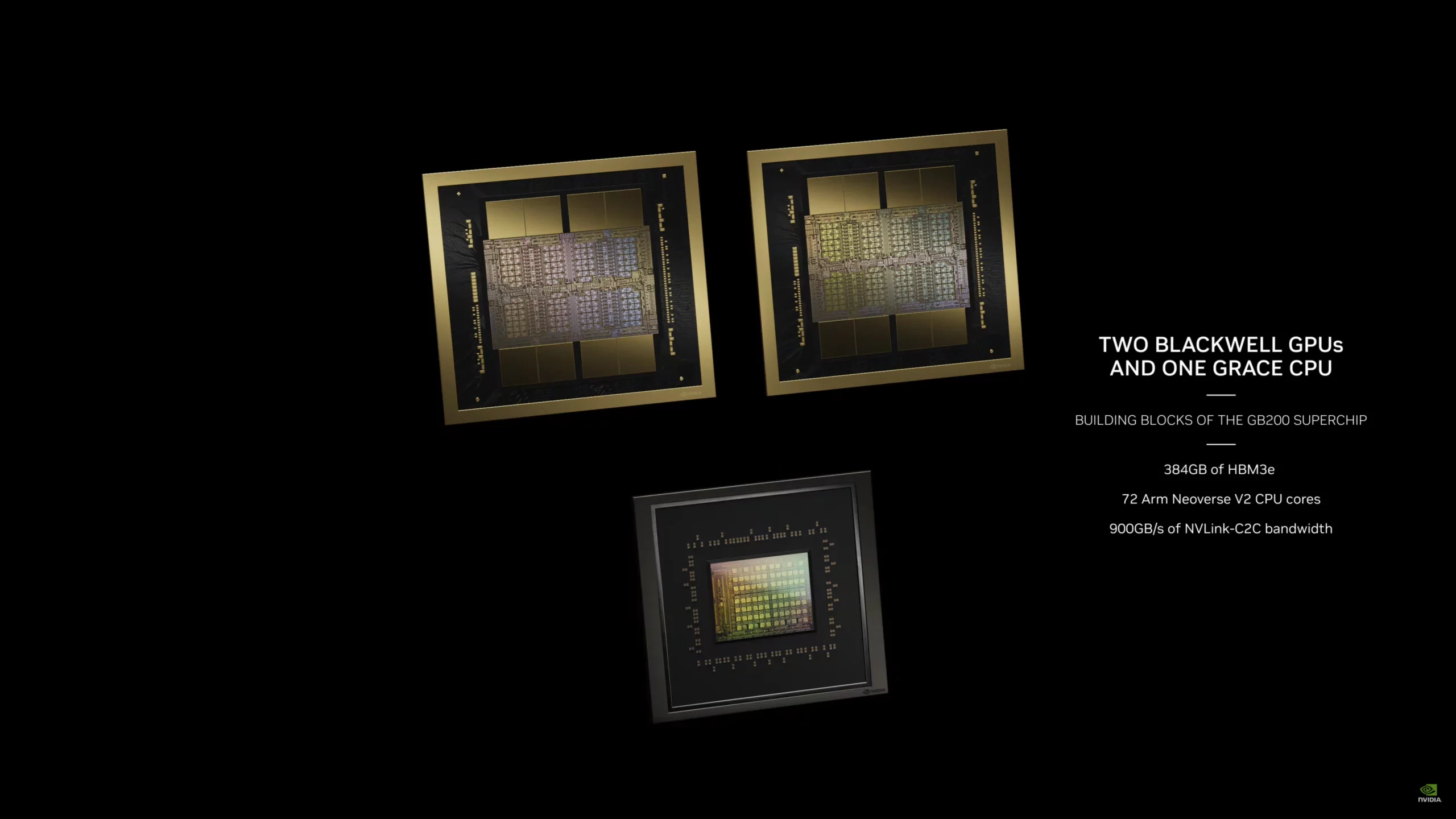

NVIDIA ha reso ufficiali i dettagli completi della sua prossima generazione di architettura GPU AI e Tensor Core, nota con il nome in codice Blackwell. Come anticipato, le GPU Blackwell rappresentano le prime ad adottare il design MCM di NVIDIA, che integra due GPU sullo stesso die.

- World’s Most Powerful Chip — Packed with 208 billion transistors, Blackwell-architecture GPUs are manufactured using a custom-built 4NP TSMC process with two-reticle limit GPU dies connected by 10 TB/second chip-to-chip link into a single, unified GPU.

- Second-Generation Transformer Engine — Fueled by new micro-tensor scaling support and NVIDIA’s advanced dynamic range management algorithms integrated into NVIDIA TensorRT™-LLM and NeMo Megatron frameworks, Blackwell will support double the compute and model sizes with new 4-bit floating point AI inference capabilities.

- Fifth-Generation NVLink — To accelerate performance for multitrillion-parameter and mixture-of-experts AI models, the latest iteration of NVIDIA NVLink® delivers groundbreaking 1.8TB/s bidirectional throughput per GPU, ensuring seamless high-speed communication among up to 576 GPUs for the most complex LLMs.

- RAS Engine — Blackwell-powered GPUs include a dedicated engine for reliability, availability and serviceability. Additionally, the Blackwell architecture adds capabilities at the chip level to utilize AI-based preventative maintenance to run diagnostics and forecast reliability issues. This maximizes system uptime and improves resiliency for massive-scale AI deployments to run uninterrupted for weeks or even months at a time and to reduce operating costs.

- Secure AI — Advanced confidential computing capabilities protect AI models and customer data without compromising performance, with support for new native interface encryption protocols, which are critical for privacy-sensitive industries like healthcare and financial services.

- Decompression Engine — A dedicated decompression engine supports the latest formats, accelerating database queries to deliver the highest performance in data analytics and data science. In the coming years, data processing, on which companies spend tens of billions of dollars annually, will be increasingly GPU-accelerated.

Scendendo nei dettagli, la GPU Blackwell di NVIDIA vanta un totale di 104 miliardi di transistor su ciascun die di calcolo, prodotto utilizzando il nodo di processo TSMC 4NP. Ogni chip è equipaggiato con un’interfaccia ad alta larghezza di banda di 10 TB/s, permettendo una connettività chip-to-chip estremamente veloce. Queste GPU sono integrate come un singolo chip all’interno dello stesso package, con un totale di fino a 208 miliardi di transistor e una completa coerenza della cache della GPU.

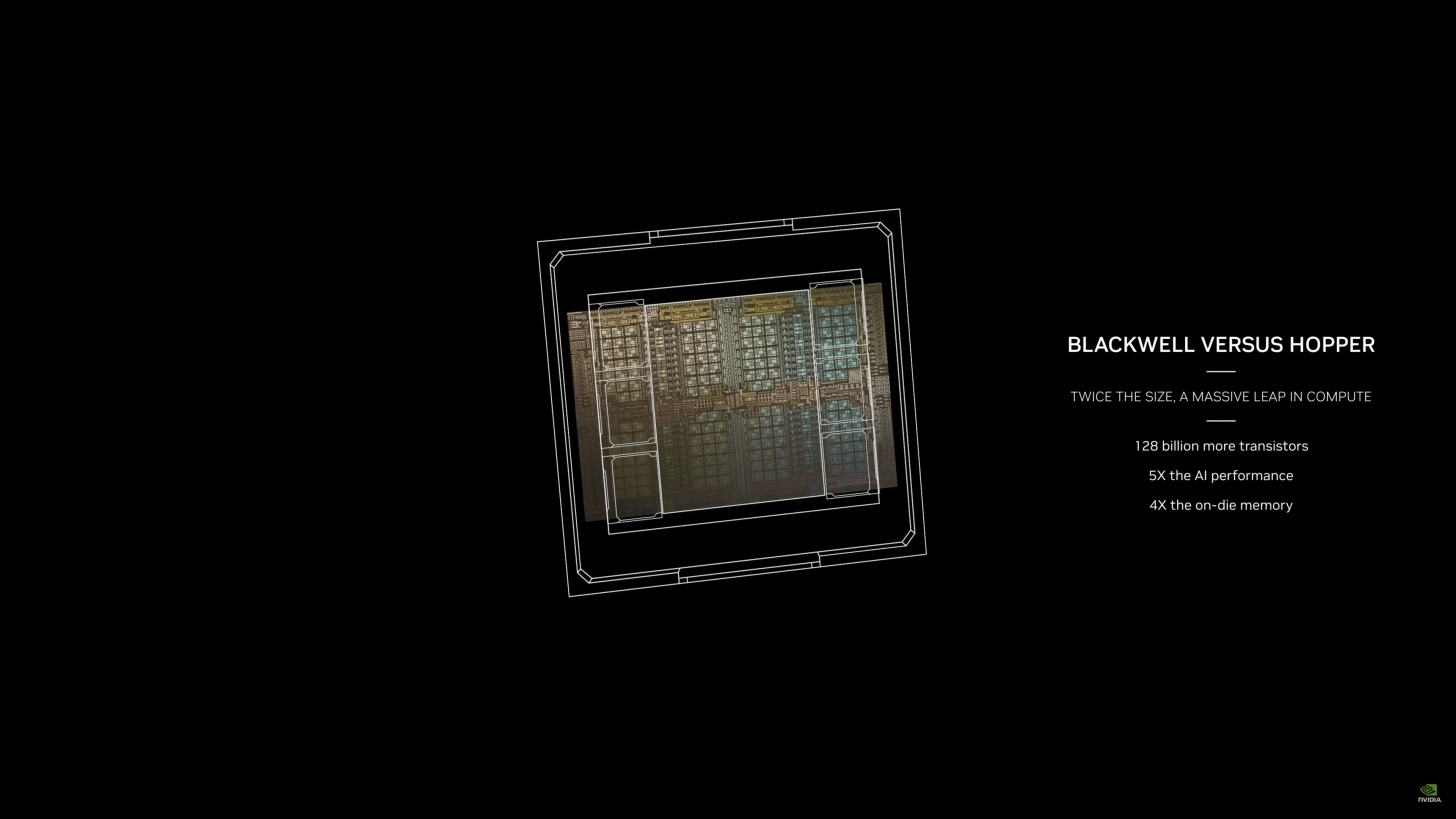

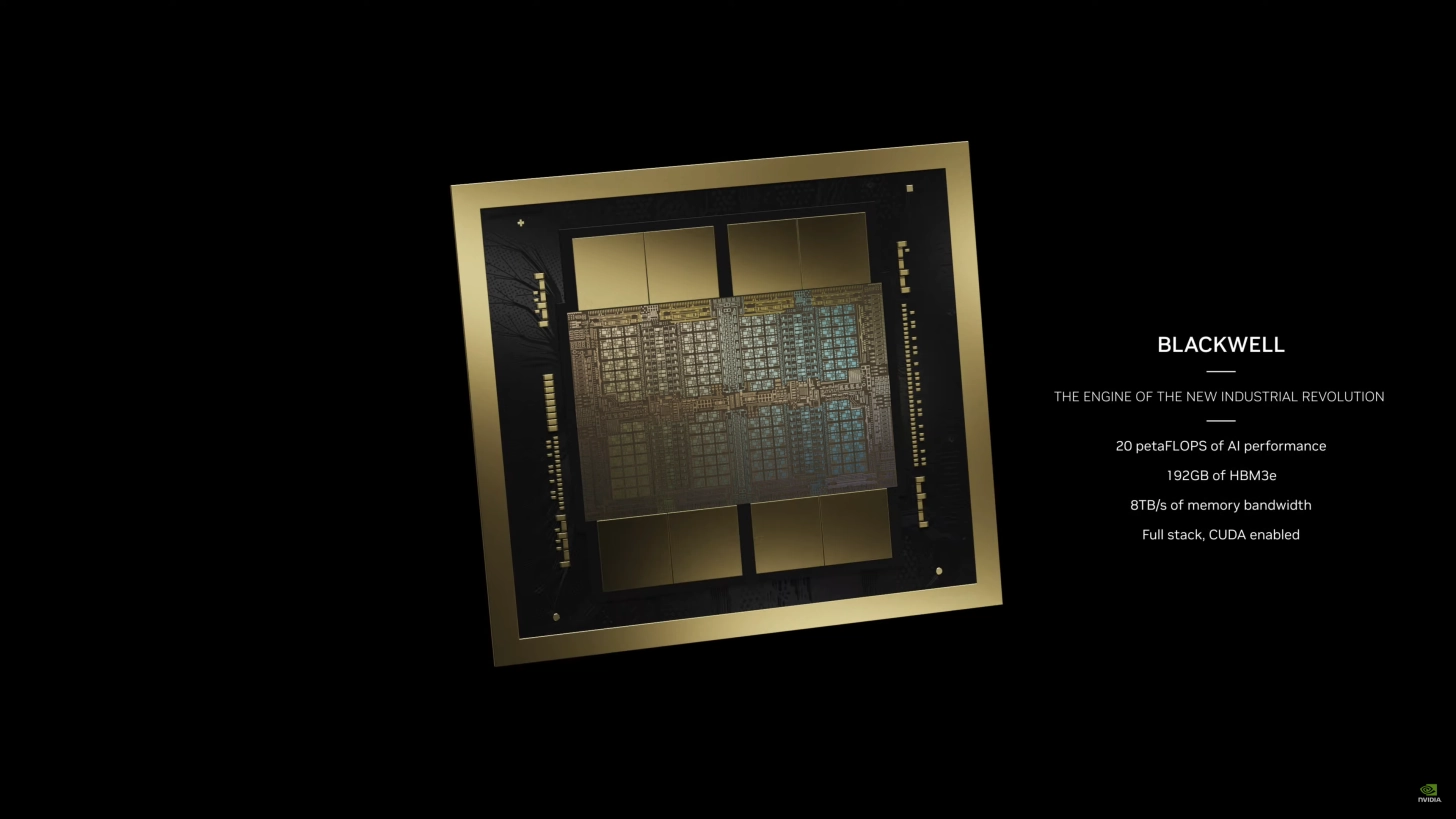

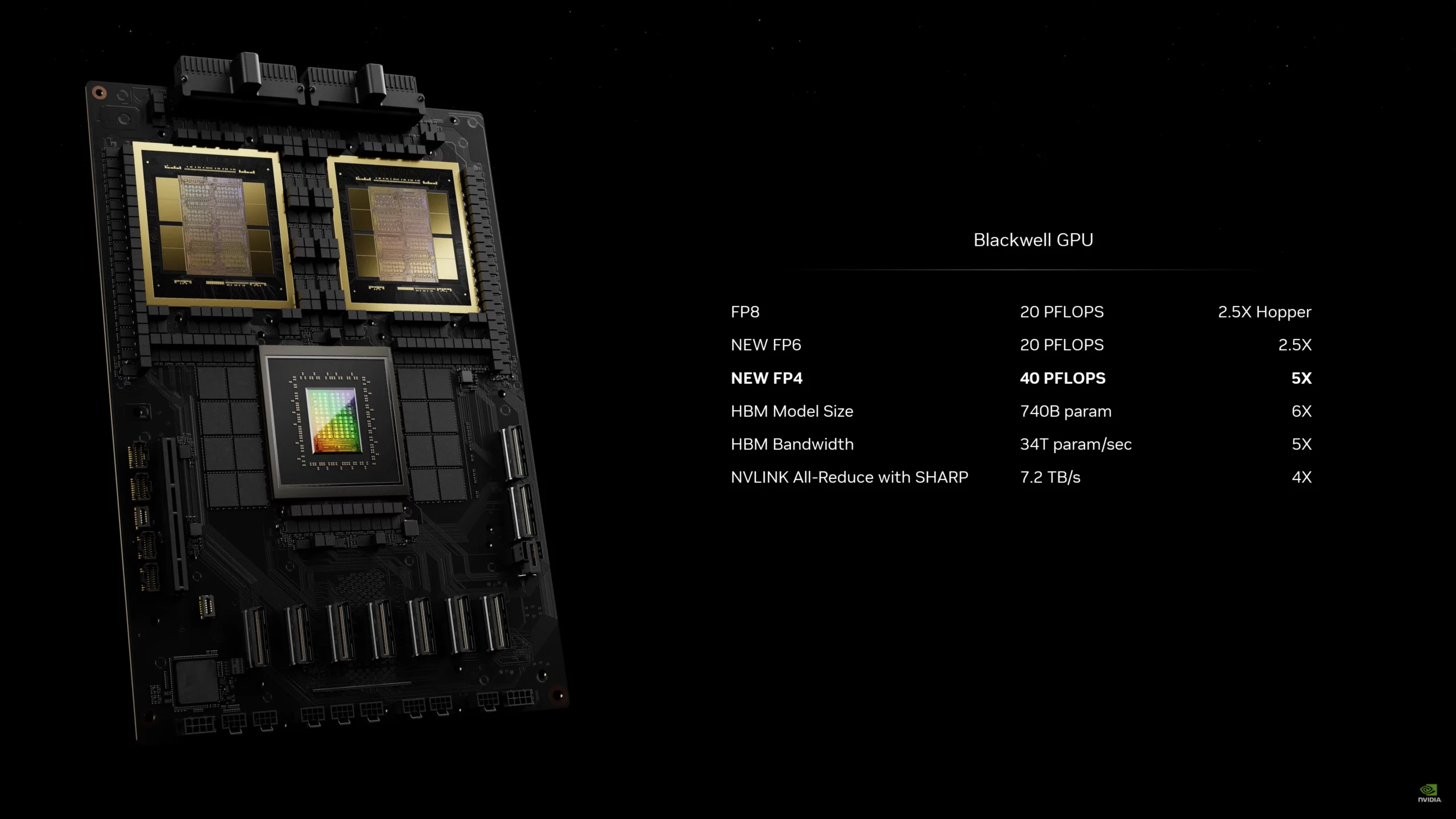

In confronto all’Hopper, la GPU NVIDIA Blackwell vanta un aumento di 128 miliardi di transistor, con prestazioni AI quintuplicate che raggiungono i 20 petaFlops per chip e una memoria on-die quadruplicata. Inoltre, la GPU è accoppiata con 8 stack HBM3e, che rappresentano la soluzione di memoria più veloce al mondo, garantendo una larghezza di banda di memoria di 8 TB/s su un’interfaccia bus a 8192 bit e fino a 192 GB di memoria HBM3e. Per un riassunto conciso delle prestazioni rispetto all’Hopper, si ha:

- 20 PFLOPS FP8 (2.5x Hopper)

- 20 PFLOPS FP6 (2.5x Hopper)

- 40 PFLOPS FP4 (5.0x Hopper)

- 740B Parameters (6.0x Hopper)

- 34T Parameters/sec (5.0x Hopper)

- 7.2 TB/s NVLINK (4.0x Hopper)

NVIDIA presenterà le GPU Blackwell come una piattaforma completa, che combina due di queste GPU, corrispondenti a quattro die di calcolo, con una singola CPU Grace (72 core CPU ARM Neoverse V2). Le GPU saranno connesse tra loro e con le CPU Grace utilizzando il protocollo NVLINK, con una velocità di trasferimento di 900 GB/s.

Prima di tutto, abbiamo la GPU NVIDIA Blackwell B200. Questo rappresenta il primo dei due chip Blackwell che verranno utilizzati in varie configurazioni, dalle unità SXM ai moduli PCIe AIC e alle piattaforme Superchip. La GPU B200 segna un’importante svolta poiché sarà la prima GPU NVIDIA a implementare un design chiplet, che comprende due die di calcolo basati sul nodo di processo TSMC a 4 nm.

L’approccio MCM (Multi-Chip-Module) è stato a lungo atteso da NVIDIA ed è finalmente giunto mentre l’azienda affronta le sfide legate ai nodi di processo di prossima generazione, come rendimenti e costi. I chiplet offrono una solida alternativa che consente ancora a NVIDIA di ottenere incrementi prestazionali significativi senza compromettere la disponibilità o i costi. Questo rappresenta solo l’inizio del percorso di NVIDIA verso l’adozione dei chiplet.

La GPU NVIDIA Blackwell B200 sarà una vera potenza. Con un totale di 160 SM per un totale di 20.480 core, rappresenterà un’impresa di ingegneria impressionante. La GPU includerà la più recente tecnologia di interconnessione NVLINK, supportando la configurazione con 8 GPU e uno switch di rete da 400 GbE. Tuttavia, sarà anche molto esigente in termini di energia, con un TDP di picco di 700 W, sebbene sia in linea con i chip H100 e H200. In breve, questo chip promette di essere un gigante nel panorama delle GPU.

- TMSC 4NP Process Node

- Multi-Chip-Package GPU

- 1-GPU 104 Billion Transistors

- 2-GPU 208 Billion Transistors

- 160 SMs (20,480 Cores)

- 8 HBM Packages

- 192 GB HBM3e Memory

- 8 TB/s Memory Bandwidth

- 8192-bit Memory Bus Interface

- 8-Hi Stack HBM3e

- 700W TDP (Peak)

Dal punto di vista della memoria, la GPU Blackwell B200 includerà fino a 192 GB di memoria HBM3e. Questa sarà organizzata in otto stack di moduli 8-hi, ciascuno con una capacità VRAM di 24 GB su un’interfaccia bus larga 8192 bit. Si tratta di un notevole aumento del 2,4 volte rispetto alle GPU H100 da 80 GB, il che permetterà al chip di gestire set di dati più ampi e complessi con facilità.

0 commenti